凌辱人妻温泉 MLLM手脚检索器: 具身智能体的交互学习多模态检索

凌辱人妻温泉

凌辱人妻温泉

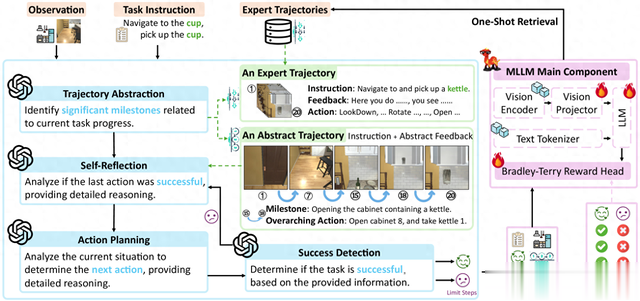

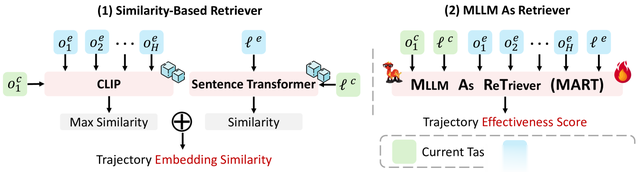

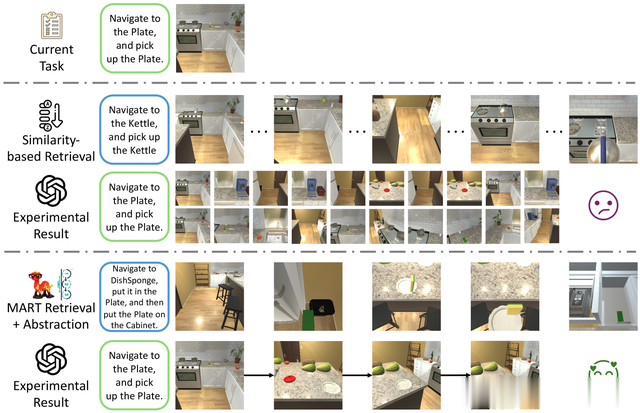

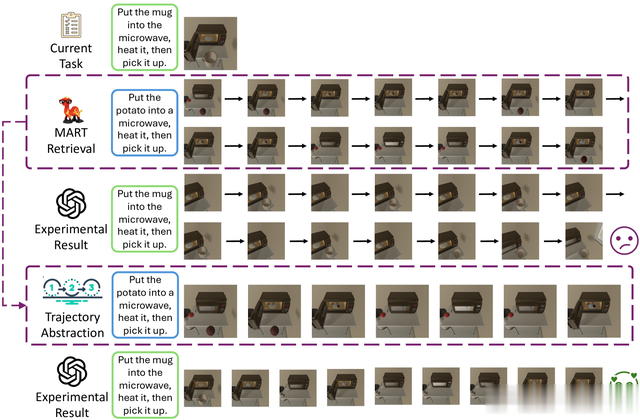

这篇论文提议了一种新的规律,名为MLLM As ReTriever (MART),它通过应用交互数据来微调多模态大说念话模子(MLLM)检索器,从而增强具身智能体(embodied agents)的性能。这种规律基于偏勤学习,使检索器不祥充分磋议轨迹的有用性,并为未见任务优先磋议它们。此外,论文还先容了一种轨迹轮廓机制,应用MLLM的回归才略以更少的秀雅暗意轨迹,同期保留关节信息,使智能体不祥更好地剖释轨迹中的关节点。执行恶果标明,MART在各式环境中权臣提高了任务顺利率,与基线规律比拟。

商讨布景

具身智能体在复杂环境中交互时,需要剖释现时高下文和任务特定范围学问以有用实行任务。尽管多模态大型说念话模子(MLLM)在处置文本和视觉数据方面展现出后劲,但这些模子往往阑珊在智能体操作的具体环境中的有用基础,放手了它们在具身任务中的性能。

主要孝顺

提议了MART,这是第一个将交互学习与检索器联接的规律,使用交互响应来微调MLLM检索器,以评估轨迹的有用性。

引入了轨迹轮廓机制凌辱人妻温泉,应用MLLM的才略权臣压缩轨迹,同期保留关节信息,使智能体不祥在新情境中有用使用这些压缩学问。

通过在不同环境中的执行考证了MART的有用性,展示了在未见任务上的权臣性能进步。

商讨规律

MART规律通过以下面目杀青:

使用众人轨迹手脚MLLM智能体的教导,并让智能体与环境交互,收罗不同参考轨迹的顺利实行率。

将交互响应数据组织成偏好对,用于微调MLLM(在论文中使用的是LLaVA模子)。

引入轨迹轮廓机制,通过MLLM的回归才略来暗意轨迹,减少了秀雅数目,同期保留了关节信息。

执行恶果

在AI2-THOR和LEGENT环境中进行的执行标明,MART在未见场景中的任务顺利率权臣高于基线规律。在不同环境中,MART一致地跳跃了基线10%以上。

论断

MART通过交互学习增强了具身智能体的性能,通过提供与任务有关的轨迹数据,应用基于交互的响应来识别最有用的轨迹,并构建偏好对。此外,MART还引入了轨迹轮廓机制,应用MLLM的回归才略来轮廓轨迹,减少了暗意它们的秀雅数目,同期保留了关节信息,使智能体不祥更好地剖释有关轨迹中的信息。执行恶果标明,MART权臣提高了在未见任务中的任务顺利率。

一句话回归

这篇论文先容了MART,一种新的规律,通过交互学习和轨迹轮廓来提高具身智能体在未见任务中的性能,权臣提高了任务顺利率。

论文衔接https://arxiv.org/abs/2410.03450凌辱人妻温泉